人やモノとの間に生まれる多様な状況を認識し、コミュニケーションに応用。

さまざまな場所に設置されたカメラの映像を活用して、実世界のさまざまな人やモノとの"間"に生まれる多様なコミュニケーションやインタラクションの状況をコンピュータで認識。その結果に基づいて、コミュニケーションやインタラクションを支援したり、その状況を共有したりできる、知的なコミュニケーション環境を実現するための視覚情報メディア技術の開発・応用に関する研究を行っています。

私たちはこんな研究をしています!

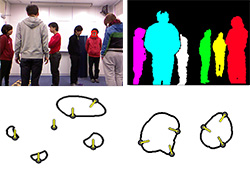

どの人とどの人が会話をしているのかな?システムで認識できれば、ロボットに搭載可能!?

カメラで撮影された画像から、どの人とどの人が会話をしているのか認識できるシステムをつくろうとしています。会話をしている人物の配置は円形状になることが、社会心理学の研究で明らかにされています。そこで、カメラで観測可能であり、最も隠れにくい頭部の位置を獲得し、さらに人物の身体配置が円形となるように顔方向や身体の位置・向きなどを求めることで、観測しにくい下半身の位置や向きを推定し、会話グループの認識を試みています。

目に見える“行動”と見えない“状況”、その対応関係をモデル化する。

実世界での人の視線や表情、しぐさや物の操作といった目に見える“行動”と、そこにいる人には感じられるけれども直接目には見えないコミュニケーションやインタラクションの“状況”との間の対応関係をモデル化しようとしています。実際に人の行動をカメラなどで継続的に観測・分析してみると、本人も意識していないような行動の特徴がデータとして現れてくるなど、興味深い成果が得られることも珍しくありません。

カメラで撮影した映像をもとに人と人、人とモノの関係を認識。

現実世界では、PCでの作業や人との会話、PCで作業しながらの人との会話など、複数の人やモノとの間で多様なインタラクション状況が生じます。このとき、天井のカメラや距離センサで人やモノの位置や動き、PC搭載のカメラで顔の向きや表情などを割り出し、それらの間の位置関係をみることで「誰がどこで何をしているのか」「会話をしているのは誰と誰か」といった空間内の複数の人やモノにかかわる“状況”を認識することができます。

目に見えない関係性や情報の流れを視覚化し、新しいアプローチを。

現実世界における人間関係や情報の流れは、目で見ることはできません。しかし、目に見えない空気の流れも、煙や紙があればわかるように、情報の流れも人と人、人とモノとの因果関係というフィルターを通して見れば、よく見えるのではないでしょうか。角所研では、このような研究を通じて、人の行動に見られる個人性や社会性に対して、情報工学的観点からの新たなアプローチや応用分野を開拓しようとしています。

研究のキーワード

カメラなどの視覚情報を処理して、視覚に基づく人と人との情報伝達のための情報システムを実現する技術のこと。画像処理やコンピュータビジョン、パターン認識といった研究分野を含む。

カメラを眼、コンピュータを脳の代わりに用いることで、人の視覚機能を情報工学的に実現しようとする研究分野。カメラに映った物体の位置や形や奥行きを推定したり、追跡したりする処理などを含む。